Insikt

Semantiskt svarscache för on-premises LLM-API:er: sänk kostnad utan att skicka data ut

Hur embeddingbaserad likhetscache fungerar på privat infrastruktur, när komplexiteten är värd det, och hur du hanterar invalidering och integritet.

Bortom exakt strängmatchning

Traditionella cachelagrar svar med exakt prompttext eller hashade promptar. Det hjälper för upprepade API-anrop från skript och omförsök, men slutanvändare formulerar sällan frågor identiskt. Semantisk cache lagrar svar nycklade med embeddinglikhet: om en ny fråga ligger tillräckligt nära i vektorrummet kan systemet returnera det lagrade svaret och hoppa över en full modellforward-pass.

On-premises distribution bryr sig om detta mönster av två skäl. För det första är GPU-tid en intern, begränsad tillgång; att undvika redundant inferens sparar kapacitet för uppgifter som verkligen behöver modellen. För det andra: att hålla embeddingar och cachelagring inom er perimeter stämmer med dataresidensförväntningar, förutsatt att ni designar cachen så den inte blir en ostyrdd kopia av känsliga svar.

Arkitekturskiss

Ett typiskt flöde beräknar en embedding för den inkommande prompten med en embeddingmodell som ni hostar lokalt. Vektorn jämförs mot poster i ett vektorindex som backas av infrastruktur ni driver, till exempel pgvector i PostgreSQL, Milvus, Qdrant eller annan självhanterad lagring. Varje indexpost pekar på en cachad svarspayload och metadata: modellversion, adapter-ID, temperatur och tidsstämplar.

Om likheten överstiger en konfigurerad tröskel och hjälpkontroller passerar returnerar gatewayen det cachade innehållet. Annars fortsätter begäran till inferens och systemet kan infoga en ny cache-rad efter att svaret genererats. Embeddingmodellen behöver inte vara samma som den generativa, men valet påverkar vad som räknas som ”liknande”, så ändringar i embeddingmodeller kräver samma försiktighet som i hämtningspipelines.

Trösklar, falska positiva och säkerhet

Likhet är inte semantisk ekvivalens. En marginellt annorlunda fråga kan ha olika regelefterlevnadsimplikationer, särskilt i reglerade arbetsflöden. Justera avståndströsklar konservativt för högriskfall och överväg högre likhetskrav när verktyg eller strukturerad utdata ingår. För kundchatt, para semantiska träffar med lätta validatorer: säkerställ till exempel att cachade svar fortfarande passerar policyfilter skrivna för färsk generering.

Namespace-cache efter tenant, produktlinje och modellkonfiguration. Ett svar som producerats under en säkerhetsprofil får inte tillfredsställa en begäran under en annan, även om promptarna ser lika ut.

Invalidering och färskhet

Cache av naturliga språksvar ruttnar när underliggande fakta ändras. Koppla cacheposter till källdokumentversioner när svar beror på RAG, eller explicit TTL för flyktiga domäner. Tillhandahåll administrativa API:er för att rensa namespace efter policyuppdateringar eller modelluppgraderingar.

När ni rullar ut en ny basmodell eller adapter, behandla cachen som misstänkt: antingen versionsnyckla cache med modellrevision eller töm relevanta partitioner. Tyst blandning av generationer ger subtila kvalitetsbuggar som är svåra att diagnostisera enbart från aggregerade mätvärden.

Integritet och dataminimering

Lagrade promptar och svar kan vara lika känsliga som primär applikationsdata. Kryptera data i vila, begränsa åtkomst till cacheadministrationsändpunkter och definiera retention i linje med er bredare loggningspolicy. Om promptar innehåller personuppgifter, dokumentera om embeddingar utgör ytterligare behandling under GDPR-ramverket och om användare kan begära radering över cacheposter.

För organisationer som redan kör hämtningsindex, överväg operativa synergier: delad embeddinginfrastruktur, enhetlig övervakning och samlad backupstrategi. Undvik att skapa en andra skugga dataplattform med svagare kontroller än era huvudsakliga vektorlager.

När semantisk cache inte bär

Interaktiv chatt med låg latens och varierande formuleringar kan se begränsad träfffrekvens tidigt. Arbetsbelastningar med tunga verktyg eller flertursstatus behöver ofta cachenycklar som inkluderar sessionskontext, vilket minskar återanvändning. Behandla semantisk cache som en spak i en bredare effektivitetsstrategi tillsammans med modellrouting, mindre modeller för enkla avsikter och batchning för offline jobb — inte en universallösning.

Pilotera mönstret på en smal API-yta först — interna dokumentationsassistenter eller upprepade analytiska frågor — där parafrasöverlapp är högt och kostnaden för en felaktig cacheträff är avgränsad. Instrumentera träfffrekvens, latensbesparingar och manuella granskningsutfall innan ni expanderar till kundvända flöden.

Att mäta framgång utan tomma mätvärden

Användbara dashboards följer GPU-sekunder undvikna, cacheträfffrekvens segmenterat per tenant och incidenter kopplade till inaktuella svar. Kvalitativ granskning förblir viktig: schemalägg periodisk stickprov av cacheträffar för att bekräfta att nästan-duplicerade promptar verkligen förtjänade samma svar. Det stickprovet stänger loopen mellan ingenjörseffektivitet och produktförtroende.

När cache blir en del av arkitekturen blir den också en delad datatillgång mellan produkt, drift och säkerhet. Då ska åtkomstkontroller och raderingsbegäran hanteras med samma stringens som för primär applikationsdata — annars köper ni effektivitet till priset av en skugga som ingen äger.

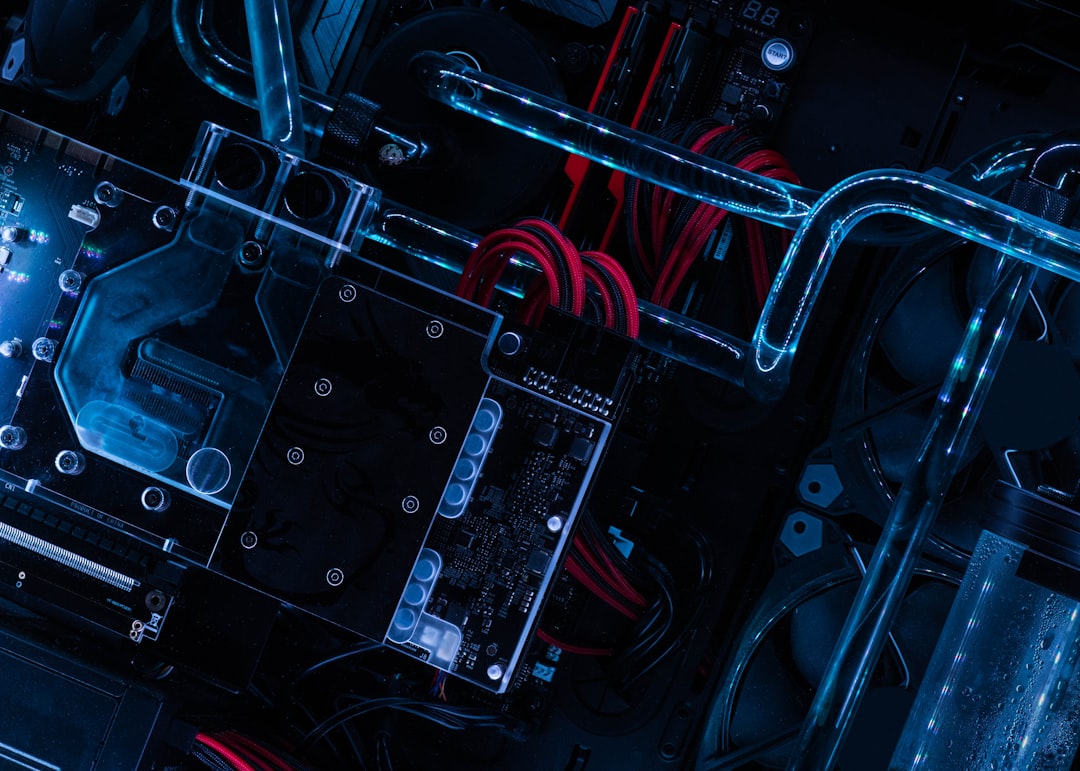

Utvald bild av Cristiano Firmani på Unsplash.